Infrared Solutions, Inc., une entreprise Fluke, a développé une nouvelle technologie infrarouge appelée IR-Fusion™ qui fusionne, pixel par pixel, les images visibles et infrarouges sur un seul écran. Cet article décrit l'approche novatrice, économique, en attente de brevet permettant de résoudre le problème de parallaxe résultant de la combinaison de l'optique dans le visible et infrarouge.

Contexte

Il existe de nombreuses raisons pour lesquelles les images visibles sont généralement plus précises et plus claires que les images infrarouges. L'une d'entre elle est que les réseaux de capteurs de lumière visible peuvent être réalisés avec des éléments de détecteurs plus petits et avec un nombre d'éléments bien supérieur. Une autre raison est que comme les images visibles ne sont pas utilisées pour mesurer la température, les images ne peuvent être générées qu'avec des rayonnements réfléchis, qui produisent habituellement des images plus précises que les rayonnements émis.

Les réseaux de détecteurs de lumière visible ont des millions d'éléments, alors que les réseaux de détecteurs infrarouges en ont bien moins. La FlexCam Fluke a un réseau visible de 1 360 000 éléments de détecteur et un réseau infrarouge avec 1/18 fois moins d'éléments (76 800). En conséquence, l'image visible peut comporter bien plus de détails que l'image infrarouge. En outre, les images visibles peuvent être affichées avec les mêmes couleurs, ombres et intensités que celles vues par l'œil humain, de sorte que leur structure et leurs caractéristiques peuvent être plus facilement interprétées que les images infrarouges.

Bien que les caméras infrarouges et visibles puissent enregistrer des rayonnements émis et réfléchis par une cible, les images visibles sont presque toujours produites par de la lumière visible réfléchie. En revanche, les images infrarouges utilisées pour mesurer la température doivent enregistrer des rayonnements infrarouges émis. Les rayonnements visibles réfléchis permettent de détecter des contours précis et des différences d'intensité. Par exemple, une fine ligne blanche peut être visualisée près d'une fine ligne noire.

Il est également possible d'avoir un contraste de réflexion infrarouge précis en ayant une surface à faible émissivité (facteur de réflexion infrarouge élevé) à côté d'une surface à émissivité élevée (facteur de réflexion infrarouge faible). Mais il n'est pas habituel d'avoir des surfaces avec des différences de température prononcées l'une à côté de l'autre. Le transfert thermique entre objets proches peut éliminer les différences de température en produisant des gradients de température, ce qui rend difficile la production d'images de rayonnement émis avec des contours précis. C'est aussi une raison pour laquelle les images infrarouges utilisées pour mesurer des températures sont moins précises que les images visibles.

L'industrie avait besoin d'une caméra pouvant capturer une image qui montrait les détails d'une image visible et la mesure de température d'une image infrarouge. La plupart des opérateurs prenaient des images en double, une à la lumière visible et une infrarouge, mais la corrélation des images était parfois peu fiable. Le besoin réel était de superposer automatiquement les deux images.

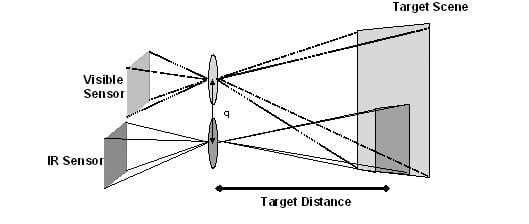

Une proposition consistait à combiner une caméra visible et une infrarouge côte à côte en un instrument, de sorte que les deux images soient prises simultanément, mais la parallaxe nuisait à la corrélation spatiale. Cela fonctionnait bien à longue distance, où la parallaxe est négligeable. Mais pour les applications comme la maintenance prédictive et les sciences du bâtiment, où la caméra est utilisée à des distances courtes à modérées, la parallaxe est un problème.

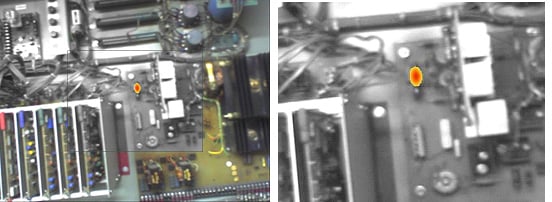

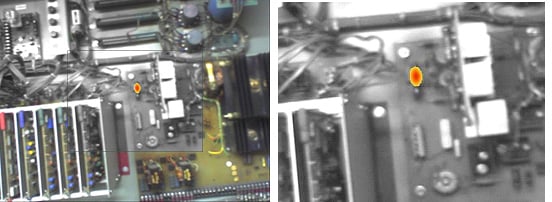

Infrarouge seul, Visible seul, Fusion 50/50

Images visibles et infrarouges fusionnées

La technologie IR-Fusion combine une caméra vidéo infrarouge avec une caméra vidéo à lumière visible en un seul instrument pour que la scène puisse être visualisée et enregistrée en rayonnement visible et infrarouge. L'image visible est automatiquement enregistrée (avec une correction de parallaxe) et dimensionnée pour correspondre à l'image infrarouge, afin que la scène infrarouge et la scène visible puissent se superposer sur l'écran de la caméra. L'opérateur peut choisir de voir l'image visible seule, l'image infrarouge seule ou une combinaison fusionnée (mélangée) des deux. Voir des exemples d'images à la Figure 1.

Comme les images infrarouges et visibles sont mises en correspondance pixel par pixel par la caméra, l'opérateur peut facilement identifier l'emplacement des points d'intérêt infrarouges sur la cible en notant où les caractéristiques se trouvent dans l'image fusionnée. Une fois que l'image infrarouge est mise au point, l'opérateur de la caméra peut choisir de ne voir que l'image en lumière visible et lire les températures infrarouges sur l'image visible des données non affichées, mais associées à l'image infrarouge correspondante. On peut voir un exemple dans le panneau visible seul de la Figure 1, qui montre le point le plus chaud à 49,8 °C.

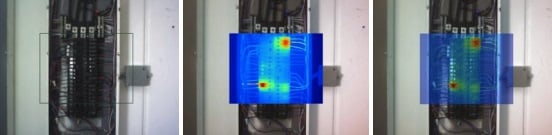

Avec l'image fusionnée, l'emplacement d'une caractéristique d'intérêt infrarouge peut être précisément identifié si le contraste infrarouge est faible et s'il y a très peu de structure dans l'image infrarouge. Dans la Figure 2, l'emplacement exact d'un point mal isolé sur une paroi plane ou un plafond peut être vu plus facilement grâce à une petite imperfection ou marque visible dans l'image fusionnée visible/infrarouge.

Modes d'affichage

Les caméras infrarouges Fluke Ti4X et 5X avec IR-Fusion™ peuvent fonctionner en cinq modes d'affichage ; 1) Picture-in-Picture (incrustation d'image) , 2) Plein écran et 3) Alarme couleur, 4) Fusion alpha, et 5) Lumière visible intégrale. Dans n'importe lequel des quatre premiers modes, les températures sont enregistrées et peuvent être affichées dans la partie infrarouge de l'image.

Fusionné

Visible seul, Infrarouge seul, Fusion modérée

Fusion 75 % IR, Fusion 50 % IR, Fusion 25 % IR

Visible seul, Infrarouge seul, Fusion 50/50

- Mode Picture-in-picture : en mode picture-in-picture, le quart central de l'écran est en infrarouge seul, visible seul ou une fusion des deux. Les trois quarts restants de l'écran sont en visible uniquement. Dans ce mode, l'image infrarouge est toujours affichée dans une position fixe au milieu de l'écran.

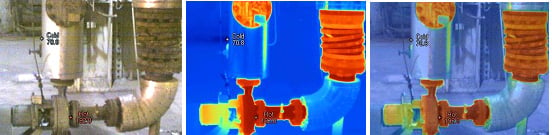

La Figure 4 représente une image fusionnée avec divers pourcentages de fusion infrarouge. - Mode plein écran : en mode plein écran, le quart central du mode picture-in-picture remplit l'écran. Comme en mode picture-in-picture, tout l'écran peut être en visible seul, en infrarouge seul ou en une fusion des deux. La Figure 5 montre une image plein écran de la même scène infrarouge représentée dans la Figure 4.

- Mode Alarme couleur : le mode alarme couleur est utilisé pour mettre en évidence des zones d'intérêt qui répondent aux critères de température particuliers définis par l'opérateur de la caméra. Trois réglages sont disponibles : a) seuil chaud, b) seuil froid et c) gamme absolue.

- En mode seuil chaud, tout pixel dans l'image avec une température supérieure à un réglage de température apparaîtra en couleurs infrarouges.

- En mode seuil froid, tout pixel dans l'image avec une température inférieure à un réglage de température apparaîtra en couleurs infrarouges.

Figure 6. Exemple d'alarme couleur avec seuil chaud défini à 148 °C. - En mode gamme absolue (isotherme), l'opérateur de la caméra spécifie une température supérieure et inférieure d'une gamme. Tout pixel avec une température dans cette gamme s'affichera en couleurs infrarouges. Dans tous les modes alarme couleur, les couleurs sont définies par la sélection de palette infrarouge et l'intensité par le degré de fusion infrarouge. L'affichage du mode peut être défini en tant qu'image incrustée (picture-in-picture) ou plein écran.

Comment est réalisée la fusion

La technologie IR-Fusion™ place le moteur d'une caméra visible en temps réel dans le logement d'une caméra infrarouge en temps réel. Le placement est tel que l'axe optique visible est aussi proche que possible de l'axe optique infrarouge et est pratiquement parallèle à l'axe infrarouge dans le plan vertical. Afin de corriger la parallaxe pour une gamme de distances cible, le champ de visée (FOV) d'une des caméras doit être plus large que l'autre. Le FOV visible a été choisi plus large car les optiques visibles sont actuellement moins onéreuses que les optiques infrarouges et les caméras visibles ont une résolution bien plus fine. Ainsi, perdre une partie de l'image visible par le processus correction de parallaxe a un impact moindre sur la caméra et les images fusionnées.

Le Schéma 1 montre le chemin optique et la configuration de capteurs de la caméra infrarouge et visible combinée. Il y a deux chemins optiques distincts et deux capteurs séparés : un pour le visible et un pour l'infrarouge. Comme les chemins optiques des capteurs sont différents, chaque capteur « verra » la scène cible depuis des vues légèrement différentes, entraînant l'erreur de parallaxe. Cette erreur de parallaxe est corrigée électroniquement dans l'image combinée avec des réglages logiciels.

Les optiques visibles sont telles qu'elles gardent la mise au point à toutes les distances utilisables. La caméra infrarouge a une ouverture numérique faible et en conséquence une profondeur de champ réduite qui donne un excellent moyen de déterminer la distance à la cible. Seules les lentilles infrarouges ont besoin de réglage de mise au point pour les cibles à des distances différentes.

Correction de parallaxe

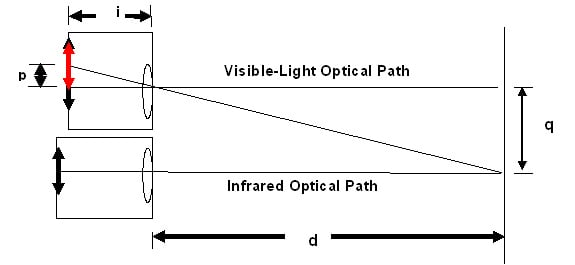

La correction de parallaxe est basée sur la distance de mise au point infrarouge. Le Schéma 2 montre géométriquement la dérivation de l'équation de parallaxe.

A partir de l'équation de lentille standard

Où : d = distance à l'objet

i = distance à l'image

f = longueur focale effective de la lentille

Et à partir du Schéma 2 :

Où : q = distance de séparation entre l'axe optique visible et infrarouge, p = décalage d'image au plan focal visible

Pour une caméra donnée, la distance de séparation q et la longueur focale de la lentille f sont fixes. Donc à partir de l'équation ci-dessus, le décalage de l'image visible n'est qu'une fonction de la distance à la cible. q d Chemin optique infrarouge p i d Chemin optique lumière visible

Lorsqu'une image est capturée, l'image visible complète et l'image infrarouge complète sont enregistrées, avec toutes les données auxiliaires, dans un fichier image sur la carte mémoire de la caméra. La partie de l'image visible non affichée qui se trouve hors des dimensions de l'affichage lorsque l'image a été prise est enregistrée dans l'image visible. Plus tard, si un réglage après traitement dans l'enregistrement entre l'image infrarouge et visible est nécessaire sur un PC, l'image visible complète est disponible pour faire ces réglages.

Conclusion

Une approche nouvelle de la résolution des problèmes de parallaxe pour une caméra avec des optiques visible et infrarouge a abouti à la commercialisation d'une caméra qui améliore de manière significative les performances et l'utilité pour les applications à la maintenance prédictive et aux sciences du bâtiment. En particulier, elle fournit des détails spatiaux largement améliorés aux images infrarouges et aide à identifier l'emplacement exact des points d'intérêt infrarouges.

Remerciements

L'auteur, Roger Schmidt, souhaite remercier l'équipe d'ingénierie d'Infrared Solutions, Inc. pour son travail exceptionnel dans l'invention et le développement de cette caméra unique. L'équipe était dirigée par Kirk Johnson et Tom McManus et soutenue par Peter Bergstrom, Brian Bernald, Pierre Chaput, Lee Kantor, Mike Loukusa, Corey Packard, Tim Preble, Eugene Skobov, Justin Sheard, Ed Thiede et Mike Thorson. L'auteur souhaite également remercier Tony Tallman pour son travail sur le logiciel PC qui a facilité la fourniture de ces images révélatrices sur le papier.